La inteligencia artificial, aliada de los delincuentes en secuestros virtuales

La IA ha traído avances importantes, pero también está siendo utilizada por delincuentes para crear fraudes más rápidos, convincentes y peligrosos.

Los fraudes y secuestros virtuales están cambiando de forma rápida y peligrosa. Ahora, los delincuentes usan inteligencia artificial generativa (IA) para crear engaños más sofisticados y convincentes, sin necesidad de ser expertos en tecnología.

Según expertos, estas herramientas permiten a los delincuentes generar mensajes, audios e imágenes falsas que parecen reales, lo que facilita manipular a sus víctimas y aumentar la credibilidad de sus amenazas. La IA puede incluso corregir errores humanos que antes delataban un intento de fraude, haciendo que los engaños sean mucho más difíciles de detectar.

La nueva amenaza: secuestros virtuales

Una de las modalidades más alarmantes es el secuestro virtual. En estos casos, los delincuentes llaman a la víctima y la obligan a salir de su casa, indicándole que debe ir a un centro comercial, plaza o hotel, sin cortar la llamada en ningún momento.

Durante el trayecto, sacan información de la familia, amigos y contactos, y luego utilizan sus redes sociales para crear videos o imágenes falsas que simulan que la víctima ha sido golpeada o maniatada. Con este material, los delincuentes exigen pagos que van de los 100 mil a los 300 mil pesos, presionando a las familias con la ilusión de que su ser querido corre peligro.

Cómo funciona la IA en estos fraudes

Clonación de voz: la IA puede reproducir la voz de familiares a partir de audios o videos que circulan en redes sociales.

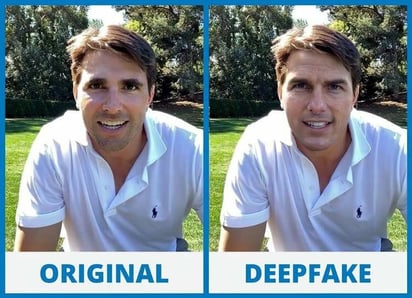

Creación de imágenes y videos: con fotos públicas de la víctima, los delincuentes pueden generar material que simula golpes o secuestros.

Mensajes personalizados: la IA analiza datos de redes sociales para enviar textos que parecen totalmente auténticos y dirigidos específicamente a la víctima.

La inteligencia artificial ha traído avances importantes, pero también está siendo utilizada por delincuentes para crear fraudes más rápidos, convincentes y peligrosos, dejando a las familias en constante alerta.

Aunque la creación de contenido sintético no es ilegal, su uso para cometer fraudes, extorsiones o secuestros virtuales convierte a la IA en un arma potente en manos de delincuentes. La combinación de presión emocional, información obtenida de redes sociales y contenido generado por inteligencia artificial hace que estas estafas sean cada vez más peligrosas y difíciles de detectar.

La clave para reducir riesgos está en la prevención, la verificación de datos y la denuncia rápida, así como en la educación sobre el uso de la tecnología y la protección de la información personal.

Seguridad: Cobrador de Banco Azteca sufre aparatosa caída en Los Pinos

Confusión inicial: No fue atropellado. La tarde de este sábado, un cobrador de Banco Azteca resultó con diversas lesiones luego de sufrir una caída mientras circulaba en su motocicleta en la colonia Los Pinos. En un principio, algunos testigos afirmaron que había sido -- leer más

Noticias del tema